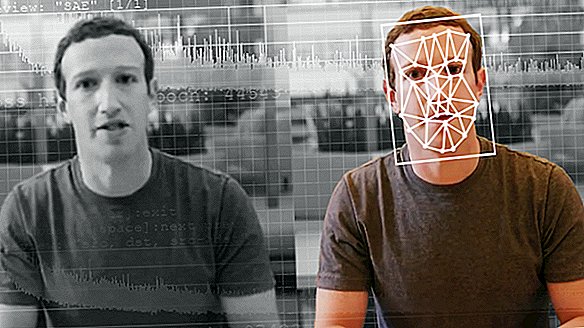

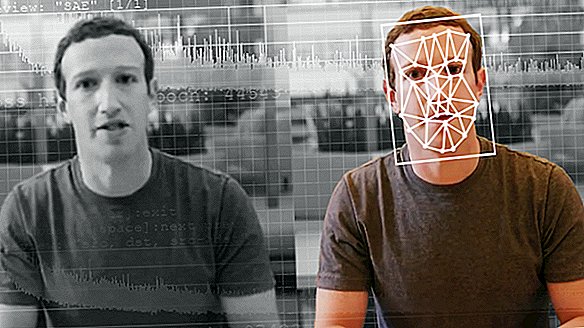

De todos os poderes assustadores da Internet, sua capacidade de enganar os inocentes pode ser a mais assustadora. Clickbait, fotos no photoshop e notícias falsas são alguns dos piores criminosos, mas nos últimos anos também houve o surgimento de uma nova ferramenta potencialmente perigosa conhecida como inteligência artificial (IA) do deepfake.

O termo deepfake refere-se a vídeo e áudio falsificados, gerados por computador, difíceis de distinguir de conteúdo genuíno e inalterado. É para filmar o que o Photoshop é para imagens.

Como a IA do deepfake funciona?

A ferramenta conta com o que chamamos de redes adversárias generativas (GANs), uma técnica inventada em 2014 por Ian Goodfellow, Ph.D. estudante que agora trabalha na Apple, informou a Popular Mechanics.

O algoritmo GAN envolve duas AIs separadas, uma que gera conteúdo - digamos, fotos de pessoas - e um adversário que tenta adivinhar se as imagens são reais ou falsas, de acordo com a Vox. A IA geradora começa com quase nenhuma ideia de como as pessoas são, o que significa que seu parceiro pode facilmente distinguir fotos verdadeiras de fotos falsas. Mas, com o tempo, cada tipo de IA melhora progressivamente e, eventualmente, a IA geradora começa a produzir conteúdo que parece perfeitamente real.

Exemplos do Deepfake

GANs são ferramentas impressionantes e nem sempre são usadas para fins maliciosos. Em 2018, uma pintura gerada pela GAN imitando o estilo holandês de "velho mestre" de artistas como Rembrandt van Rijn, do século XVII, foi vendida na casa de leilões da Christie's por incríveis US $ 432.500.

No mesmo ano, os deepfakes alcançaram grande destaque, principalmente por meio de um usuário do Reddit que recebeu o nome de 'deepfakes', informou o Vice. A técnica GAN costumava ser usada para colocar os rostos de celebridades famosas - incluindo Gal Gadot, Maisie Williams e Taylor Swift - nos corpos de atrizes de filmes pornográficos.

Outros GANs aprenderam a tirar uma única imagem de uma pessoa e a criar fotos ou vídeos alternativos bastante realistas dessa pessoa. Em 2019, um deepfake pode gerar filmes assustadores, mas realistas, da Mona Lisa falando, se movendo e sorrindo em posições diferentes.

O Deepfakes também pode alterar o conteúdo de áudio. Conforme relatado pelo The Verge no início deste ano, a técnica pode dividir novas palavras em um vídeo de uma pessoa falando, fazendo parecer que eles disseram algo que nunca pretendiam fazer.

A facilidade com que a nova ferramenta pode ser implantada tem ramificações potencialmente assustadoras. Se alguém, em qualquer lugar, pode fazer filmes realistas mostrando uma celebridade ou político falando, movendo e dizendo palavras que nunca disseram, os espectadores são forçados a ficar mais cautelosos com o conteúdo da internet. Como exemplo, basta ouvir o aviso do presidente Obama contra um futuro distópico "efetivo" neste vídeo do Buzzfeed, criado usando o deepfake pelo cineasta Jordan Peele.